近期,第十二届开源操作系统年度技术会议(OS2ATC)在京举行,大会以“智联系统”为主题,云集国内顶尖开源及操作系统专家团队展开前沿探索。会上,北京人形机器人创新中心凭借全国首个通用具身智能数据集RoboMIND获评“最佳开源智能突破奖”。这一殊荣不仅彰显了北京人形机器人在具身智能领域的研究实力,更标志着全球机器人操作系统研究迈入数据驱动的新阶段。

作为我国开源操作系统领域最具权威性的学术会议,OS2ATC 2025由北京航空航天大学联合北京大学、清华大学等顶尖学府共同举办,大会聚焦操作系统与人工智能的深度融合,吸引了来自学术界和产业界的数百位专家学者参与研讨。北京人形机器人的RoboMIND多构型机器人操作开源数据集从众多优秀参选项目中脱颖而出,荣获"最佳开源智能突破奖"。

RoboMIND数据集介绍页面:

RoboMIND主页:https://x-humanoid-robomind.github.io/

HuggingFace:https://huggingface.co/datasets/x-humanoid-robomind/RoboMIND

北京人工智能公共算力平台:https://data.flopsera.com/data-detail/21181956226031626?type=open

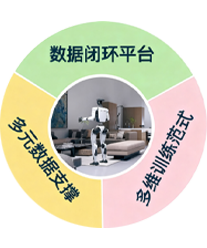

RoboMIND是北京人形机器人于2024年12月发布的全国首个通用具身智能数据集和Benchmark,其核心突破在于开创性地构建了标准化、规模化、多元化的机器人操作数据体系。北京人形机器人技术团队联合北京大学等机构深度协同创新,通过自主研发的智能数据采集平台,投入2000平方米实验场地及超过10万人工时,组建了涵盖机器人学、计算机视觉、自然语言处理等多学科的专业团队,实现了跨Franka、UR5e、AgileX、TienKung四大异构机器人平台的统一数据规范,成功攻克了多构型机器人数据兼容的技术难题。目前数据集已包含10.7万条高质量操作轨迹,涵盖479种任务场景和96类物体交互,预计年底将扩展至30万条规模,堪称目前全球最完备的机器人操作数据库之一。

在技术创新方面,RoboMIND实现了三大突破——首先,RoboMIND数据集采用细粒度语言标注,通过大模型自动分割与人工校验相结合的方式,完成了10,000余帧精准标注,为视觉-语言-动作(VLA)模型训练提供了更精密的关键支撑;同时,北京人形机器人团队在数据集中建立了失败学习机制,创新性地引入5,000余条失败轨迹及原因分析,填补了机器人反思学习的数据空白,为机器人反思学习(RLHF)提供关键训练资源;此外,北京人形机器人技术团队还基于Nvidia Isaac Sim构建高保真数字孪生环境,生成了30,000余条仿真轨迹,开创了虚实协同训练的新模式。

在数据标准方面,RoboMIND数据集通过构建完善的标准化体系,为具身智能研究提供了高质量的基准数据资源。项目团队制定并严格遵循8类质检标准,涵盖数据完整性、标注准确性、时序一致性等关键维度,确保每条轨迹数据均达到研究级可靠性。同时,数据集采用多视角RGB-D观测、机器人本体状态及任务语言描述的三维统一表征框架,填补了异构机器人操作数据标准化缺失的行业空白。为提升数据可用性,项目配套开源了完整的工具链生态,包括基于HDF5格式的高效数据解析接口、NVIDIA Isaac Sim仿真环境部署方案及基准算法库,形成从数据采集到模型训练的全流程技术闭环。RoboMIND数据集遵循Apache 2.0开源协议的设计理念,不仅实现了技术规范的透明化,更通过标准化数据接口显著降低了研究门槛,使全球开发者能够基于统一基准开展创新工作,真正体现了开源精神对技术普惠的推动作用。

当前,RoboMIND数据集已在全球范围内产生深远影响。超过百家顶尖研究机构和企业将其作为基准数据集应用于算法研发,仅北京智算平台的下载量就已达数千次。RoboMIND数据集不仅解决了机器人学习领域长期存在的数据匮乏问题,更通过标准化数据格式和完备的工具链,大幅降低了研究门槛,推动了整个领域的快速发展。

本次获奖标志着北京人形机器人在具身智能研究领域的创新成果受到了行业的充分认可,随着数据规模的持续扩充和应用生态的日臻完善,RoboMIND数据集将成为连接学术研究与产业应用的关键桥梁,为具身智能技术的产业化落地提供坚实的数据基础。北京人形机器人将继续深化产学研合作,推动开源生态建设,通过持续的技术创新为全球人工智能发展注入新动能,助力我国在新一轮科技革命和产业变革中占据战略主动地位。